Les outils d’intelligence artificielle générative comme ChatGPT, Copilot ou Gemini se sont rapidement imposés dans les usages professionnels. Rédaction de documents, génération de code, analyse de données, automatisation de tâches… ces solutions promettent des gains de productivité considérables.

Mais derrière ces nouveaux usages se cache une question essentielle pour les organisations : que deviennent les données que l’on partage avec ces outils ?

Comprendre les enjeux liés aux LLM (Large Language Models) est aujourd’hui indispensable pour exploiter l’IA tout en protégeant les informations sensibles de l’entreprise.

Les LLM : le moteur des outils d’IA générative

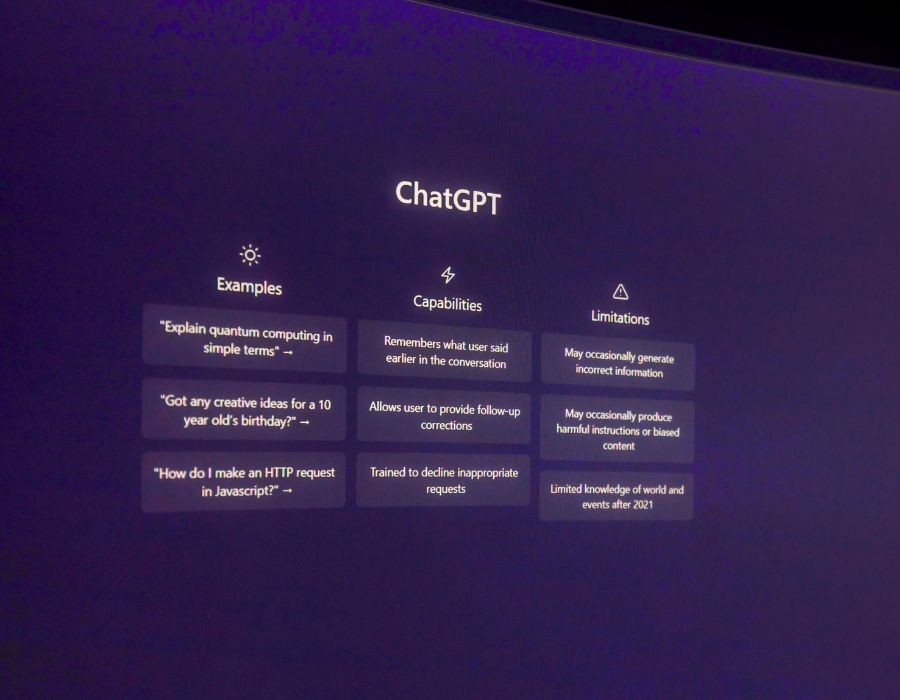

Les solutions comme ChatGPT ou Copilot reposent sur des Large Language Models (LLM), des modèles d’intelligence artificielle capables de comprendre, analyser et générer du langage naturel. Ces modèles sont entraînés sur d’immenses volumes de données afin d’identifier des structures linguistiques et produire des réponses cohérentes aux requêtes des utilisateurs.

Dans un contexte professionnel, ces outils peuvent être utilisés pour rédiger des emails, générer des rapports, analyser des documents ou assister les équipes techniques dans certaines tâches. Leur capacité à traiter rapidement de grandes quantités d’informations en fait des assistants particulièrement puissants.

Cependant, leur fonctionnement implique souvent que les requêtes et les données envoyées soient traitées par des infrastructures externes, généralement dans le cloud. Cela signifie que les informations saisies par les utilisateurs peuvent quitter le périmètre direct de l’entreprise.

Un risque de partage involontaire des données sensibles

L’un des principaux risques liés à l’usage des LLM en entreprise concerne la divulgation involontaire d’informations sensibles. Un collaborateur peut par exemple copier un extrait de document interne dans une requête adressée à un outil d’IA afin d’obtenir une reformulation ou une analyse.

Dans certains cas, ces données peuvent contenir des informations stratégiques : données clients, informations financières, projets en cours ou éléments confidentiels liés à l’activité de l’entreprise. Si ces informations sont envoyées vers un service externe, cela peut poser des questions importantes en matière de confidentialité, de sécurité et de conformité réglementaire, notamment vis-à-vis du RGPD.

De nombreuses organisations découvrent ainsi que leurs collaborateurs utilisent des outils d’IA générative de manière spontanée, sans cadre précis ni règles d’usage clairement définies.

De nouveaux usages… mais aussi de nouvelles menaces

L’intelligence artificielle ne crée pas seulement de nouveaux usages, elle modifie également le paysage des menaces cyber. Les cybercriminels peuvent désormais utiliser ces technologies pour générer des contenus malveillants beaucoup plus crédibles.

Les attaques de phishing, par exemple, peuvent être automatisées et personnalisées grâce aux LLM. Les messages frauduleux sont alors mieux rédigés, plus cohérents et plus difficiles à détecter pour les utilisateurs.

Cette évolution renforce l’importance de mettre en place des stratégies de sécurité adaptées aux nouveaux usages de l’IA, combinant technologies de protection et sensibilisation des équipes.

Encadrer l’utilisation de l’IA en entreprise

Face à ces enjeux, les entreprises doivent intégrer l’usage de l’IA dans leur stratégie de gouvernance des données et de cybersécurité. L’objectif n’est pas de bloquer ces outils, mais d’en encadrer l’utilisation de manière responsable.

Plusieurs bonnes pratiques peuvent être mises en place :

- définir une charte d’utilisation de l’IA pour les collaborateurs

- identifier clairement les données qui ne doivent jamais être partagées avec des outils publics

- privilégier, lorsque c’est possible, des solutions d’IA sécurisées ou hébergées dans des environnements maîtrisés

- former les équipes aux risques liés à l’IA générative et aux bonnes pratiques.

En adoptant cette approche, les organisations peuvent profiter des bénéfices de l’IA tout en limitant les risques pour leurs données et leurs systèmes.

Altanis Protect vous accompagne dans l’encadrement de l’IA

Chez Altanis Protect, nous accompagnons les entreprises et organisations publiques dans l’intégration sécurisée de l’intelligence artificielle. Cela passe par l’analyse des risques liés aux usages de l’IA, la mise en place de politiques d’utilisation adaptées et la sensibilisation des collaborateurs.

Dans un contexte où les technologies évoluent rapidement, il devient essentiel de gouverner, protéger et sensibiliser pour faire de l’intelligence artificielle un véritable levier de performance, sans compromettre la sécurité des données. Contactez-nous !